# 文件管理

文件管理用于统一存储和管理作业流、作业运行所需的各类脚本、JAR包和配置文件。

可以管理项目中 Spark 程序、Flink 程序、MapReduce 程序、Python 程序相关的依赖资源,比如 jar,并在开发程序时进行引用。

提示:

文件默认使用的是LOCAL存储,务必在安装调度引擎时配置。

文件默认使用的是LOCAL存储,务必在安装调度引擎时配置。

参考 DolphinScheduler 的 4.对接分布式或远端对象存储

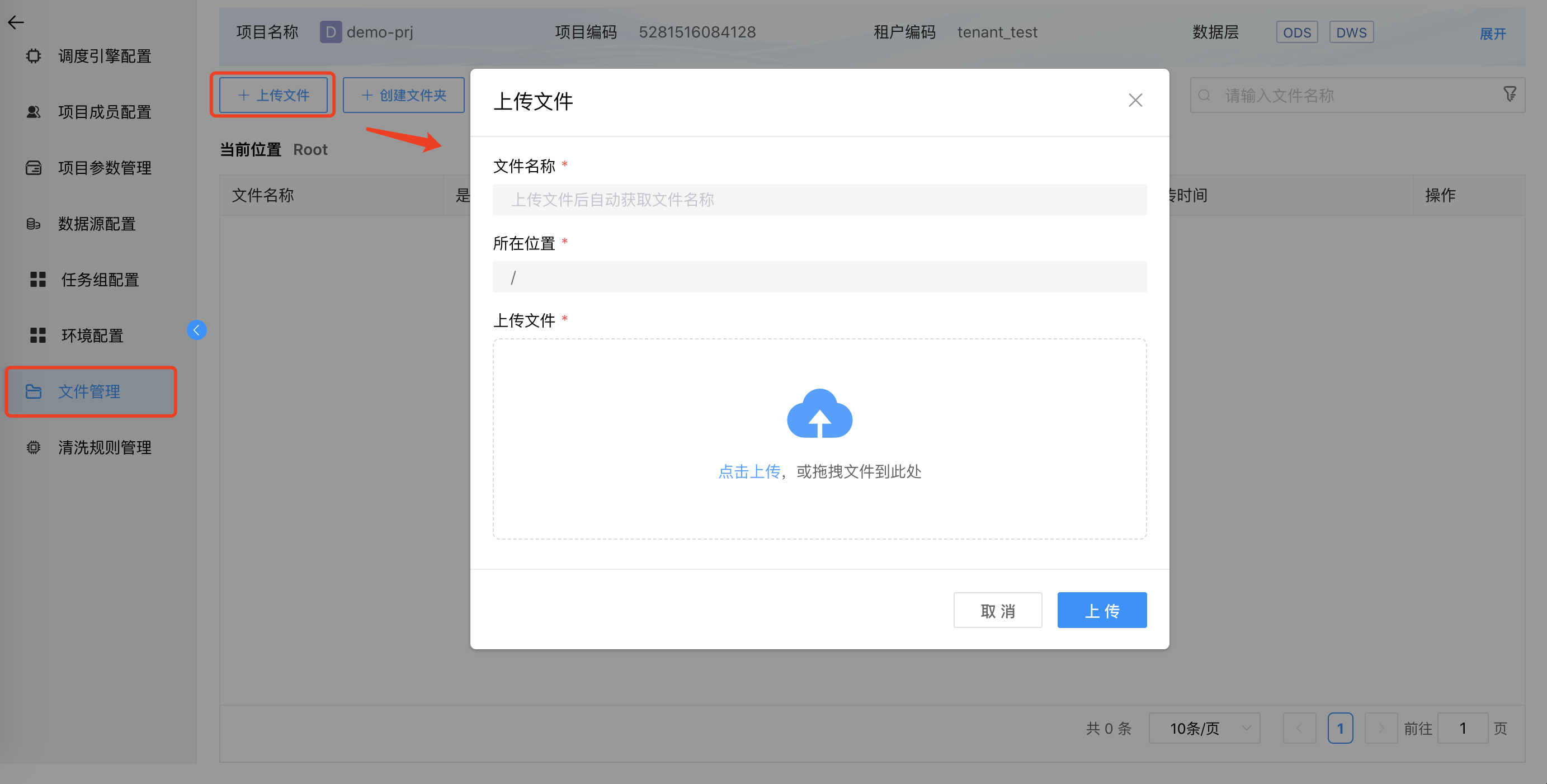

# 功能入口

点击项目卡片的【项目配置】,进入项目配置主页面,点击左侧菜单【文件管理】。

# 上传文件

无严格限制,常见如 .jar、.zip、.py。

特别注意:上传的JAR包或脚本必须在任务定义中“选中”关联,才会在任务运行时被分发到 Worker 节点。

若调度引擎已经注册且项目中已经绑定了调度引擎,当修改了调度引擎的存储方式(如将LOCAL改为HDFS),则配置完并重启dolphinscheduler后:

- 在【调度引擎管理】中重新保存调度引擎,

- 在【项目开发】相关项目的【项目配置】-【调度引擎配置】中,点击“刷新”按钮,刷新调度引擎的配置信息。

# 常见问题

任务找不到文件

检查任务定义中是否已勾选该资源。仅上传到资源中心不够,必须在任务里关联。

权限错误(如HDFS写权限)

配置 resource.hdfs.root.user 为有读写权限的用户,或确保Worker启动用户有对应权限。

多节点文件不一致

检查所有节点的 common.properties 是否完全一致,且使用了共享存储(HDFS/S3)。