# 微应用版安装

文档中以 Linux(Centos7) 操作系统、 MySQL 数据库为示例进行安装。

新安装环境建议使用数据资产7.5.0版本自发版-2026/01/12补丁合集已更新,详情见产品补丁列表:数据资产7.5.0版本补丁列表 (opens new window)

产品默认安装目录是/opt/primeton,该路径可以自行修改,注意修改后下述文件路径自行调整

# 一、安装介质准备

1.数据资产微服务版:

Primeton_DAMP_7.5.0_MicroApp.tar.gz(包含DAMP前后端、服务引擎、元数据751、公共资源组件)

2.EOS8.3.3基础环境:

EOS_Platform_8.3.3_Private_Medium_Application.tar.gz(基础运行环境,必须)

EOS_Platform_8.3.3_Private_Medium_Service.tar.gz(可选,主要涉及到日志采集和监控模块)

2.Nginx:推荐使用1.20.1版本。(必须)

3.Redis:推荐使用6.2.6版本。(必须)

4.ElasticSearch:支持6.8.11和8.1.2版本。(必须)

5.JDK:推荐使用Oracle JDK1.8.0_162。(必须)

6.filebeat:使用ElasticSearch配套的版本。(服务日志采集组件,可选)

7.logstash:使用ElasticSearch配套的版本。(服务日志采集组件,可选)

8.MetaCube:元数据7.5.1版本(必须)

9.Idata:Idata最新版本(可选,使用数据指标必须安装)

10.数据质量:如果需要使用数据质量,需要单独下载数据质量7.3.0微应用介质部署。

EOS8.3.3环境搭建(必须)EOS8.3.3环境搭建。

Afcenter集成公共资源组件(必须)Afcenter集成公共资源组件

Nginx可以参考(必须) Nginx安装说明

Redis可以参考(必须) Redis安装说明

ElasticSearch可以参考(必须)ElasticSearch安装说明

元数据安装参考(必须) 元数据详细安装步骤。

IDATA可以参考 IDATA安装说明

# 二、介质解压

1、创建目录

## 配置文件路径默认/opt/primeton(如果修改注意配置文件全部替换)

2、将介质复制到/opt/primeton 授权并解压

chmod -R 777 Primeton_DAMP_7.5.0_MicroApp.tar.gz

tar -zxvf Primeton_DAMP_7.5.0_MicroApp.tar.gz

3、文档结构

微应用版:Primeton_DAMP_7.5.0_MicroApp.tar.gz

├── Primeton_MetaCube_7.5.1.tar.gz

│ ├── Primeton_MetaCube_7.5.1_UI.tar

│ ├── Primeton_MetaCube_7.5.1_Server.tar

│ └── Primeton_MetaCube_7.5.1_Extractor.tar

├── pubresmng_component_v8.3.3.0.zip

│ ├── backend #backend,公共资源后端

│ │ ├── pubresmng_ext_lib

│ │ └── pubresmng_lib

│ ├── config

│ │ └── application-comp-pubresmng.properties

│ ├── frontend #frontend,公共资源前端

│ │ └── pubresmng_app.zip

│ │ ├── pubresmng #公共资源管理前端资源

│ │ └── sqlclient #SQL客户端前端资源

│ ├── meta.json

│ ├── script

│ └── version.properties

├── Primeton_DAMP_7.5.0_DataEngine.tar.gz

│ ├── docs

│ ├── bin

│ ├── config

│ │── db-scripts

│ ├── com.primeton.data.service.engine.boot-7.5.0.jar

│ ├── lib

│ └── version.properties

├── Primeton_DAMP_7.5.0_Server.tar.gz

│ ├── baseline

│ │ └──deploy

│ │ └──DAMP_lowcode_resource.zip ## 数据资产低开基线,第一次启动DAMP时自动加载低开资源

│ ├── material

│ │ └──deploy

│ │ └──DAMP_assetlib.zip

│ ├── bin

│ ├── com.primeton.data.dam.portal.boot-7.5.0.jar

│ ├── config

│ ├── damp

│ ├── db-scripts

│ ├── lib

│ ├── template-file

│ └── version.properties

└── Primeton_DAMP_7.5.0_UI.tar.gz

└── web

├── dam

├── dataService

└── dm

├── ibi

├── metrics

└── standard

# 第三步、 数据库初始化

# 创建数据库用户/Schema

创建 damp 数据库。以Mysql为例,执行如下脚本:

CREATE DATABASE `damp` DEFAULT CHARACTER SET utf8mb4;

# 执行初始化脚本

微应用安介质安装时需要按顺序执行对应数据库的数据库初始化脚本。初始化脚本路径为 Primeton_DAMP_7.5.0_Server/damp/db-scripts/,根据不同数据库类型做了不同的目录。目前已经适配的数据库包括Mysql5.7、Postgresql12、达梦V8、人大金仓V8R6、高斯openGuass 5.0.0、ORACLE 19c。

目前数据库脚本一共分成了4部分,分别是bfp、eos、lowcode和damp。 其中bfp、eos、lowcode作为基础组建依赖,都需要在damp库中做初始化,默认执行all.sql即可。 damp中包含了afcenter的数据初始化内容,需要分别在damp、afcenter两个库中执行对应脚本。

以Mysql为例,按顺序执行如下脚本:

1)在damp数据库下执行:

1.bfp

db-scripts/bfp/Mysql/all.sql

2.eos

db-scripts/eos/Mysql/all.sql

3.lowcode

db-scripts/lowcode/Mysql/all.sql

4.damp

db-scripts/damp/Mysql/dam-all.sql

5.如果使用达梦数据库,在执行上述脚本后,需要在damp数据库下额外执行下面的SQL语句。否则可能导致启动服务时redis加载数据报错。

DELETE FROM COMP_SYSTEM_CONFIG WHERE CONFIG_ID = '1';

INSERT INTO COMP_SYSTEM_CONFIG (CONFIG_ID, CONFIG_TYPE, PARENT_ID, REF_ID, CONFIG_KEY, CONFIG_VALUE, CREATE_BY, CREATE_TIME, UPDATE_BY, UPDATE_TIME, TIP, SORT, CONTROL_TYPE, VALUE_PROVIDER) VALUES ('1', 'SYS', '-1', '-1', 'metacube1', '元数据配置', NULL, NULL, NULL, NULL, '元数据配置', 1, '1', NULL);

2)在afcenter数据库下执行:

1.db-scripts/damp/dam-afc-all.sql #需要先完成afcenter基础环境数据库的初始化

3)流程BPS的初始化是在第一次启动服务的时候自动完成,无需手动初始化,应用启动顺序:afcenter->bps->damp。

# 第四步、DAMP 后端部署

# 1.解压介质

在/opt/primeton/server目录下创建 damp 文件夹,将 Primeton_DAMP_7.5.0_Server.tar.gz 复制到 damp 目录下并解压。

# 2.配置文件修改

微应用安介质安装时的配置文件,有需要修改的地方会在后面用“###”提示说明。

1.damp/config/application.properties #公共配置

2.damp/config/application-afc.properties #afcenter集成配置

3.damp/config/application-damp.properties #damp自身配置

4.damp/config/application-nacos.properties #nacos注册中心配置

5.damp/config/bootstrap.properties #nacos配置中心配置

6.damp/config/DAMP/config/user-config.xml #damp数据源配置

7.damp/config/application-dm.properties #7.2版本新增,用于建模模块配置

8.damp/config/application-job.properties #7.3版本新增,用于afc-xxl集成

9.damp/config/application-dws.properties #7.5.0版本新增,用于集成数据开发平台SDK

10.damp/config/application-dqms.properties #7.5.0版本新增,用于集成质量SDK

1)公共配置:damp/config/application.properties

server.port=28078 ###可根据实际情况修改,注意端口冲突

spring.application.name=DAMP ###原则上不允许修改

server.servlet.session.timeout=PT120M

spring.session.store-type=none

server.app-server.accept-count=1000

server.app-server.max-connections=10000

server.app-server.max-threads=500

server.app-server.min-space-threads=50

#file upload

spring.servlet.multipart.max-file-size=100MB ###文件上传大小限制,与nginx配套修改

spring.servlet.multipart.max-request-size=100MB ###同上

#spring.profiles.active=eureka

spring.profiles.active=nacos,afc,damp,dm,job,dqms,service,dws

spring.autoconfigure.exclude=org.springframework.boot.autoconfigure.mongo.MongoAutoConfiguration

management.endpoints.web.exposure.include=hystrix.stream,health,info,loggers,eos,mappings

out.config.folder=config

eos.application.sys-code=EOS-DEMO-SYS ###EOS默认配置,可以不修改。如果在Governor中配置需要根据配置情况修改

eos.application.sys-key=dc6baaed30e541d78bb91274803d9432 ###同上

# eos environment: dev prod test

eos.profiles.active=dev

# eos-cache

eos.cache.mode=redis

spring.redis.host=127.0.0.1 ###修改redis对应ip,本机则不需要修改

spring.redis.port=6379 ###修改redis对应端口,默认端口不需要修改

spring.redis.password= ###如果redis开启认证则需要配置密码

spring.redis.lettuce.pool.max-active=100

spring.redis.lettuce.pool.max-idle=100

spring.redis.lettuce.pool.max-wait=5000

2)afcenter组件配置:damp/config/application-afc.properties

afc.application.name=AFCENTER ###根据实际情况修改

afc.application.tenant=sys_tenant

bps.application.name=BPS-SERVER ###根据实际情况修改

bps.tenant.id=

# attachment

# mode: local,db,nexus,aliyun-oss,minio ###7.3.1 新增minio

afc.attachments.persistence-mode=local ###根据实际情况修改

afc.attachments.local.dir=

afc.attachments.nexus.repository-url=

afc.attachments.nexus.username=

afc.attachments.nexus.password=

afc.attachments.aliyun-oss.endpoint=

afc.attachments.aliyun-oss.access-key-id=

afc.attachments.aliyun-oss.access-key-secret=

afc.attachments.aliyun-oss.bucket-name=

afc.attachments.libre-office.host=

afc.attachments.libre-office.port=

# 公共资源管理模块配置

# if use nacos/eureka

#public-resource.application.name=PUBLIC-RESOURCE #根据实际情况修改

# else

public-resource.application.name=AFCENTER

3)damp组件配置:damp/config/application-damp.properties

eos.export.depend-api-contributions=com.primeton.data.dam.api,com.primeton.data.service.api,com.primeton.data.standard.api,com.primeton.data.dam.metrics.api

# dm

dm.application.name=127.0.0.1:28078 ###7.2版本引入了建模模块,因此改成本地接口调用,后续版本会替换成sdk

# quality

quality.application.name=QUALITY ###数据质量应用名,用于接口调用访问,可以配置成ip+端口,也可以配置成应用名

quality.application.afctoken=bc93c0c535f846a5ac17cc8d6fc86f01 ###根据实际情况修改

# damp security filter

damp.user.request.filter.enabled=false

damp.user.request.filter.keywords=is_admin,role,is_sso,isadmin,issso

damp.user.request.filter.pagesize=limit,pageSize ###7.3.1增加安全过滤拦截

#DAMP Schedul

damp.homepage.summary.time=0 0/30 * * * ? ###业务门户统计定时调度,根据实际情况修改

damp.standard.summary.time=0 0 2 * * ? ###标准落标统计定时调度,根据实际情况修改

damp.standard.recommend.time=0 0 22 * * ? ###标准关联推荐定时调度,根据实际情况修改

damp.query.datasource.envtype=dev

metric.warning.check.time=0 0/30 * * * ? ###指标值域定时检核调度,根据实际情况修改

4)注册中心配置:damp/config/application-nacos.properties

spring.cloud.nacos.discovery.enabled=true

spring.cloud.nacos.discovery.server-addr=127.0.0.1:8848 ###根据实际情况修改

#spring.cloud.nacos.discovery.username=nacos

#spring.cloud.nacos.discovery.password=nacos

eureka.client.enabled=false

5)配置中心配置:damp/config/bootstrap.properties

spring.cloud.nacos.config.enabled=true

spring.cloud.nacos.config.server-addr=127.0.0.1:8848 ###根据实际情况修改

#spring.cloud.nacos.config.username=nacos

#spring.cloud.nacos.config.password=nacos

6)数据源配置:damp/config/DAMP/config/user-config.xml

...

<group name="default"> ### 根据实际情况修改

<configValue key="Database-Type">MySql</configValue>

<configValue key="Jdbc-Type"/>

<configValue key="C3p0-DriverClass">com.mysql.jdbc.Driver</configValue>

<configValue key="C3p0-Url">jdbc:mysql://127.0.0.1:3306/damp?useUnicode=true&characterEncoding=UTF-8&serverTimezone=GMT%2B8&useSSL=false</configValue>

<configValue key="C3p0-UserName">username</configValue>

<configValue key="C3p0-Password">password</configValue>### 明文密码,启动后会自动加密

<configValue key="C3p0-PoolSize">10</configValue>

<configValue key="C3p0-MaxPoolSize">50</configValue>

<configValue key="C3p0-MinPoolSize">10</configValue>

<configValue key="C3p0-MaxIdleTime">600</configValue>

<configValue key="C3p0-IdleConnectionTestPeriod">900</configValue>

<configValue key="C3p0-MaxStatements">0</configValue>

<configValue key="C3p0-NumHelperThreads">1</configValue>

<configValue key="Transaction-Isolation">ISOLATION_DEFAULT</configValue>

<configValue key="Test-Connect-Sql">SELECT count(*) from EOS_UNIQUE_TABLE</configValue>

<configValue key="Retry-Connect-Count">1</configValue>

</group>

...

7)建模配置:damp/config/application-dm.properties

#jackson

spring.jackson.date-format=yyyy-MM-dd HH:mm:ss

spring.jackson.time-zone=GMT+8

spring.jackson.default-property-inclusion=non-null

spring.jackson.deserialization.fail-on-unknown-properties=false

#jpa

spring.jpa.open-in-view=false

spring.jpa.properties.javax.persistence.validation.mode=none

spring.jpa.hibernate.ddl-auto=none

spring.jpa.properties.hibernate.show_sql=true

spring.jpa.properties.hibernate.format_sql=true

spring.jpa.show-sql=false

## Database Dialect 数据库方言设置,如数据库不是MYSQL请根据实际情况放开对应数据库注释

## MySQL

spring.jpa.properties.hibernate.dialect=org.hibernate.dialect.MySQL5Dialect

## Oracle

# spring.jpa.properties.hibernate.dialect=org.hibernate.dialect.Oracle10gDialect

## SQLServer

# spring.jpa.properties.hibernate.dialect=org.hibernate.dialect.SQLServer2012Dialect

## Dameng

#spring.jpa.properties.hibernate.dialect=org.hibernate.dialect.DmDialect

### GaussDB

#spring.jpa.database=postgresql

#spring.jpa.properties.hibernate.dialect=org.hibernate.dialect.PostgreSQL9Dialect

#spring.jpa.properties.hibernate.temp.use_jdbc_metadata_defaults = false

#task

spring.task.scheduling.pool.size=5

spring.task.execution.pool.core-size=50

spring.task.execution.pool.max-size=100

spring.task.execution.pool.queue-capacity=100000

#file upload

spring.servlet.multipart.max-file-size=100MB

spring.servlet.multipart.max-request-size=100MB

spring.servlet.multipart.enabled=true

spring.servlet.multipart.location=${user.dir}/data/upload-tmp

spring.servlet.multipart.file-size-threshold=100KB

management.endpoints.web.exposure.include=*

management.health.redis.enable=false

# damp

damp.application.name=127.0.0.1:28078 ###damp默认端口,根据实际情况修改

8)定时任务配置(7.3版本默认是关闭状态,无需修改,但是没有会报错):damp/config/application-job.properties

### web

management.health.mail.enabled=false

### mybatis

mybatis.mapper-locations=classpath*:mybatis-mapper/*Mapper.xml

#mybatis.type-aliases-package=com.xxl.job.admin.core.model

### xxl-job, email

spring.mail.host=smtp.qq.com

spring.mail.port=25

spring.mail.username=xxx@qq.com

spring.mail.from=xxx@qq.com

spring.mail.password=xxx

spring.mail.properties.mail.smtp.auth=true

spring.mail.properties.mail.smtp.starttls.enable=true

spring.mail.properties.mail.smtp.starttls.required=true

spring.mail.properties.mail.smtp.socketFactory.class=javax.net.ssl.SSLSocketFactory

### afc-job, access token

#xxl.job.accessToken=

### afc-job, i18n (default is zh_CN, and you can choose "zh_CN", "zh_TC" and "en")

xxl.job.i18n=zh_CN

## afc-job, triggerpool max size

xxl.job.triggerpool.fast.max=200

xxl.job.triggerpool.slow.max=100

afc.job.admin.enabled=false

afc.job.executor.enabled=false

### afc-job, log retention days

xxl.job.logretentiondays=30

# executor

### xxl-job, access token

#afc.job.executor.accessToken=default_token

#afc.job.executor.address=

#afc.job.executor.ip=

#afc.job.executor.port=9999

#afc.job.executor.logPath=

#afc.job.executor.logRetentionDays=

9)集成数据开发SDK配置(7.5.0版本新增):damp/config/application-dws.properties

dws.application.name=DWS

dws.application.tenant=sys_tenant

workflow.project.name=DAMP ###dws自动创建项目名称,根据实际情况修改

workflow.project.entype=dev #开发环境,暂不支持修改

workflow.project.levels=ODS ###dws自动创建作业层级,根据实际情况修改

trigger.freq.daily=0 0 0 ? * * ###每天 作业调度时间,根据实际情况修改

trigger.freq.weekly=0 0 0 ? * 2 ###每周 作业调度时间,根据实际情况修改

trigger.freq.semiannually=0 0 0 1 1/6 ? ###半年作业调度时间,根据实际情况修改

trigger.freq.annually=0 0 0 1 1 ? * ###每年作业调度时间,根据实际情况修改

trigger.freq.monthly=0 0 0 1 * ? * ###每月作业调度时间,根据实际情况修改

10)集成数据质量SDK配置(7.5.0版本新增,质量为独立微应用配置无需修改,但没有会报错):damp/config/application-dqms.properties

eos.springmvc.eos-serialize.exclude-packages=com.primeton.dqms

mybatis.type-aliases-package=com.primeton.dqms.entity

#mybatis.mapper-locations=classpath*:mapper/**/*Mapper.xml

mybatis.configuration.call-setters-on-nulls=true

mapper.mappers=com.primeton.dqms.core.mapperBase.MyMapper

mapper.not-empty=false

#mapper.identity=NORMAL

pagehelper.page-size-zero=true

# OpenGuass,postgresql,kingbase dialect use postgresql

pagehelper.helperDialect=mysql

pagehelper.reasonable=true

pagehelper.supportMethodsArguments=true

common.base_dir=${app.home:.}

#logging.level.com.primeton.dqms=debug

hadoop.hdfs_type=local

hadoop.tenent_name=

hadoop.core-site=${common.base_dir}/config/core-site.xml

hadoop.hdfs-site=${common.base_dir}/config/hdfs-site.xml

hadoop.user_keytab=${common.base_dir}/config/user.keytab

hadoop.krb5_file=${common.base_dir}/config/krb5.conf

hadoop.fileDownloadUrl=http://127.0.0.1:50070

cache.type=mem

datashard.type=local

datashard.base_path=${common.base_dir}/upload

datashard.delSrc=true

datashard.fileSuffix=.bcp

datashard.ftp.host=127.0.0.1

datashard.ftp.port=2121

datashard.ftp.userName=admin

datashard.ftp.password=primeton000000

datashard.sftp.host=127.0.0.1

datashard.sftp.port=22

datashard.sftp.userName=root

datashard.sftp.password=primeton

file.dqms.otherErrorDataFilePath=${common.base_dir}/dataCheck/otherErrorData

file.dqms.dataSummaryFilePath=${common.base_dir}/dataCheck/dataSummary

file.dqms.errorDetailFilePath=${common.base_dir}/dataCheck/errorDetail

file.damp.dataTemplateFilePath=${common.base_dir}/resourceTemplate/resourceTemplate.xlsx

file.damp.templateFileLocation=${common.base_dir}/fileTemplate/dataResourceImport.xlsx

file.damp.VerificationTemplatePath=${common.base_dir}/resourceTemplate/VerificationTemplate.xlsx

file.damp.clclassTemplateFilePath=${common.base_dir}/resourceTemplate/classifDataImport.xlsx

# Optional

metacube.address=http://127.0.0.1:10800/dgs

datacheck.conf.corePoolSize=10

datacheck.conf.maxPoolSize=50

datacheck.conf.queueCapacity=300

datacheck.conf.keepAliveSeconds=1000

datacheck.checkResult.warehouseType=apache

datacheck.checkResult.checkFileLocalTempDir=${common.base_dir}/dataCheck

datacheck.checkResult.checkFileUploadRootDir=${common.base_dir}/dataCheck

datacheck.checkResult.isSyncHadoop=true

datacheck.DBkerberos.path=${common.base_dir}/kerberos/

#dqms.datasource.sync.enabled=true

#dqms.datasource.sync.cron=0 */5 * * * ?

dqms.scheduler.route-strategy=FIRST

dqms.scheduler.block-strategy=SERIAL_EXECUTION

afc.system-variable.tenantId=sys_tenant

afc.system-variable.mdm-resGroupId=quality-11

afc.system-variable.afc-resGroupId=quality-12

afc.user.dqms-admin-role=dqms-92

check.result.save-mode=local

#check.result.host=10.15.15.136

#check.result.port=22

#check.result.username=test

#check.result.password=test

check.result.local-temp-dir=${common.base_dir}/dataCheck

check.result.upload-root-dir=${common.base_dir}/dataCheck

#check.result.kerberosPath=/opt/kerberos

#check.result.hdfsConfPath=/opt/hdfsConf

datasource.config.save-mode=local

#datasource.config.host=

#datasource.config.port=

#datasource.config.username=

#datasource.config.password=

#datasource.config.reply=

#datasource.config.kerberosPath=/opt/kerberos

#datasource.config.hdfsConfPath=/opt/hdfsConf

# 0mins 0seconds 1hours 1date *month ? explain: 1:00 of first day of each month

# eg: 0 0 16 29 * ? -> 16:00 of 29th of each month

rating.statistics.cron=0 0 1 1 * ?

# statistic the grades of each org for present cycle or last cycle, 'true' present last cycle

rating.statistics.last_rating_cycle=true

#DEFAULT_RATING_CYCLE:month , eg: month year week quarter

rating.statistics.cycle=month

xxl.job.admin.addresses=http://127.0.0.1:28083

xxl.job.admin.token=c0101b6109e8478784ceb8897159fe2b

spring.servlet.uploadPath=${common.base_dir}/dataUpload

# 第五步、dataEngine 后端部署

# 1.解压介质

1. 在/opt/primeton/server下创建 dataengine目录。

2. 将 Primeton_DAMP_7.5.0_DataEngine.tar.gz 复制到 dataengine目录下,解压后将数据库驱动放到 lib 目录下。

# 2.配置文件修改

服务引擎配置 server/dataengine/config/application.properties:

根据实际情况修改端口、redis及数据库连接信息

...

# redis

spring.redis.host=127.0.0.1

spring.redis.port=6379

# spring.redis.username=

spring.redis.password=

...

5、服务引擎数据源配置 server/dataengine/config/DataEnginePROD/config/user-config.xml:

...

<group name="default"> ## 根据实际情况修改

<configValue key="Database-Type">MySql</configValue>

<configValue key="Jdbc-Type"/>

<configValue key="C3p0-DriverClass">com.mysql.jdbc.Driver</configValue>

<configValue key="C3p0-Url">jdbc:mysql://127.0.0.1:3306/damp?useUnicode=true&characterEncoding=UTF-8&serverTimezone=GMT%2B8&useSSL=false</configValue>

<configValue key="C3p0-UserName">username</configValue>

<configValue key="C3p0-Password">password</configValue>## 明文密码,启动后会自动加密

<configValue key="C3p0-PoolSize">10</configValue>

<configValue key="C3p0-MaxPoolSize">50</configValue>

<configValue key="C3p0-MinPoolSize">10</configValue>

<configValue key="C3p0-MaxIdleTime">600</configValue>

<configValue key="C3p0-IdleConnectionTestPeriod">900</configValue>

<configValue key="C3p0-MaxStatements">0</configValue>

<configValue key="C3p0-NumHelperThreads">1</configValue>

<configValue key="Transaction-Isolation">ISOLATION_DEFAULT</configValue>

<configValue key="Test-Connect-Sql">SELECT count(*) from EOS_UNIQUE_TABLE</configValue>

<configValue key="Retry-Connect-Count">1</configValue>

</group>

...

# 3.filebeat安装配置(可选)

用户服务调用会在logs目录下产生api.log日志,filebeat会采集日志并传输至logstash。因此在配置中注意api日志的绝对路径以及logstash服务地址和端口。 在filebeat下创建此文件:data-engine-filebeat.yml

filebeat.inputs:

- type: log

paths: ["/opt/primeton/server/dataengineprod/logs/api.log*"] ##服务引擎日志地址,根据实际安装情况修改路径

encoding: UTF-8

fields:

log-type: api-log

tags: ["api-log"]

exclude_files: [".gz$"]

json.keys_under_root: true

json.add_error_key: true

json.overwrite_keys: true

output:

logstash:

hosts: ["127.0.0.1:5044"] ##对应logstash访问地址,根据实际情况修改

# 启动&配置

#启动filebeat

[root@autotest-01 filebeat-7.0.0-linux-x86_64]# ./filebeat -c data-engine-filebeat.yml &

注意:

- filebeat 需要与Elasticsearch版本保持一致。

- filebeat 需要和 dataengine 安装在同一台服务器上。

# 4.logstash安装配置(可选)

在logstash下创建data-engine.conf配置文件,内如如下:

input {

beats {

port => 5044 ##默认端口,如果冲突可修改,filebeat需要同步修改。

}

}

filter {

date {

match => [ "time", "UNIX_MS" ]

locale => "cn"

timezone => "Asia/Shanghai"

target => "covert-time"

}

# calculate time UTC + 8h -> Asia/Shanghai

ruby {

code => "event.set('covert-time', event.get('covert-time').time.localtime + 8*60*60)"

}

mutate {

convert => ["covert-time", "string"]

}

# -----

# replace logstash @timestamp with log timestamp, and output.elasticsearch create index use this time

# -----

date {

match => [ "covert-time", "YYYY-MM-dd'T'HH:mm:ss.SSSZ", "ISO8601" ]

locale => "cn"

timezone => "Asia/Shanghai"

}

}

output {

elasticsearch {

hosts => ["127.0.0.1:9200"] ##Elasticsearch访问地址,根据实际情况修改

index => "%{[fields][log-type]}-%{+YYYY.MM.dd}"

document_type => "log"

}

}

# 启动&配置

#启动logstash

[root@autotest-01 logstash-7.17.9]# ./bin/logstash -f config/data-engine.conf 2>&1 &

注意:

- logstash 需要与Elasticsearch版本保持一致。

# 第六步、 前端配置

# 1.解压介质

- 将Primeton_DAMP_7.5.0_UI.tar.gz,放入/opt/primeton/目录下;

- 解压文件即可 tar -zxvf Primeton_DAMP_7.5.0_UI.tar.gz。

# 2. 配置文件修改

- 将Primeton_DAMP_7.5.0_Server/damp/damp.conf,复制到/opt/primeton/web/conf/目录下;

若damp.conf与eos.conf存在冲突,可以手动进行合并。

- 在 nginx 安装目录下的 conf/nginx.conf 配置文件中增加数据资产前端配置,在配置文件中添加 include /opt/primeton/web/conf/*.conf; ##-根据实际情况修改文件路径。

user root; ###根据实际用户配置,建议使用root启动

worker_processes 1; ###根据实际情况配置,除非测试环境否则不建议1

#error_log logs/error.log;

#error_log logs/error.log notice;

#error_log logs/error.log info;

#pid logs/nginx.pid;

events {

worker_connections 1024;

}

http {

include mime.types;

default_type application/octet-stream;

client_max_body_size 100M;

client_body_buffer_size 10M;

fastcgi_intercept_errors on;

#log_format main '$remote_addr - $remote_user [$time_local] "$request" '

# '$status $body_bytes_sent "$http_referer" '

# '"$http_user_agent" "$http_x_forwarded_for"';

#access_log logs/access.log main;

sendfile on;

#tcp_nopush on;

#keepalive_timeout 0;

keepalive_timeout 65;

#gzip on;

include /opt/primeton/web/conf/*.conf; ##-根据实际情况修改文件路径

}

- 检查 nginx 配置文件,配置在/opt/primeton/web/conf/damp.conf。默认不需要做特殊配置。

upstream eosgateway {

server 127.0.0.1:9090; #gateway默认端口

}

#EOS afcenter by gateway

server {

listen 80;

#client_body_buffer_size 10m; #缓存区大小

client_max_body_size 100m;

#默认没有,元数据集成配置,如果不做单点登录可以不配。

location /fd_dgs/ {

proxy_pass http://127.0.0.1:83/ ;

}

#默认没有,元数据集成配置,如果不做单点登录可以不配。

location ^~ /dgs {

charset utf-8;

proxy_pass http://127.0.0.1:28079;

}

location ~ /(.*)/api/ {

proxy_set_header X-EOS-SourceSysKey dc6baaed30e541d78bb91274803d9432;

proxy_pass http://eosgateway;

}

location ~ \.biz\.ext$ {

proxy_set_header X-EOS-SourceSysKey dc6baaed30e541d78bb91274803d9432;

proxy_pass http://eosgateway;

}

location / {

root "/opt/primeton/web/afcenter";

access_log /opt/primeton/web/logs/access.log ;

error_log /opt/primeton/web/logs/error.log warn;

index index.html index.htm;

try_files $uri /index.html;

}

}

#代理元数据,也可单独增加一个metacube.conf

server {

listen 83;

proxy_buffer_size 128k;

proxy_buffers 32 128k;

proxy_busy_buffers_size 128k;

proxy_set_header Host $host;

proxy_set_header X-Real-IP $remote_addr;

proxy_set_header X-Real-Port $remote_port;

proxy_set_header REMOTE-HOST $remote_addr;

proxy_set_header X-Forwarded-For $proxy_add_x_forwarded_for;

location / {

root /opt/primeton/web/metacube;

index index.html index.htm;

try_files $uri /index.html;

}

location /dgs {

charset utf-8;

proxy_pass http://127.0.0.1:28079;

}

}

- 修改IDATA外部访问地址

根据真实情况修改数据资产前端配置地址例:/opt/primeton/web/afcenter/ibi/config.js

(function () {

// 将配置信息放在window对象上,使其变成全局都可以访问的,需要修改为真实IP,改地址为IDATA外部访问地址

window.configs = {

baseServerUrl: 'http://127.0.0.1:8026/cboard/',

user: 'admin',

password: 'root123'

}

})();

# 第七步、启动服务

# 1.后端启动

[root@localhost server]# ./opt/primeton/server/damp/bin/startup.sh

[root@localhost server]# ./opt/primeton/server/dataengine/bin/startup.sh

注意:

- 若damp启动报错,请检查afcenter,bps是否启动,正确启动顺序:afcenter->bps->damp。

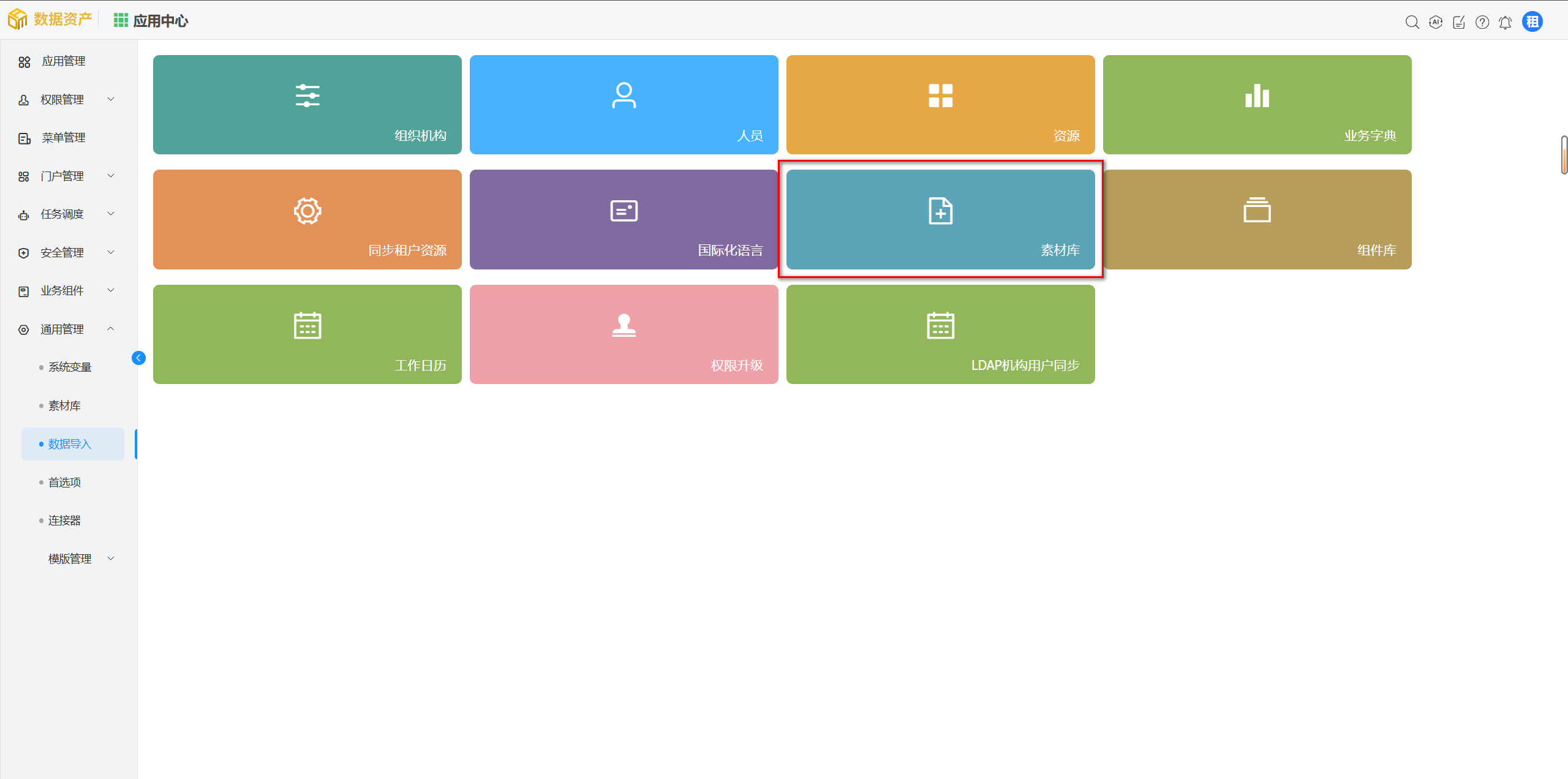

- 适配MYSQL数据库时,若启动后,报'max_allowed_packet'太小,导致数据未初始化成功,可在菜单【应用中心】->【通用管理】->【数据导入】->【同步租户资源】,选择应用DAMP进行同步;

# 2.前端启动

[root@localhost nginx]# ./sbin/nginx

# 第八步、环境登录和验证

访问 http://localhost,使用初始用户登录,初始用户名、密码为:admin/000000。

若无资产管理相关菜单,可对当前用户授予数据资产管理员、部门管理员、资产普通用户等角色!

# 第九步、平台配置

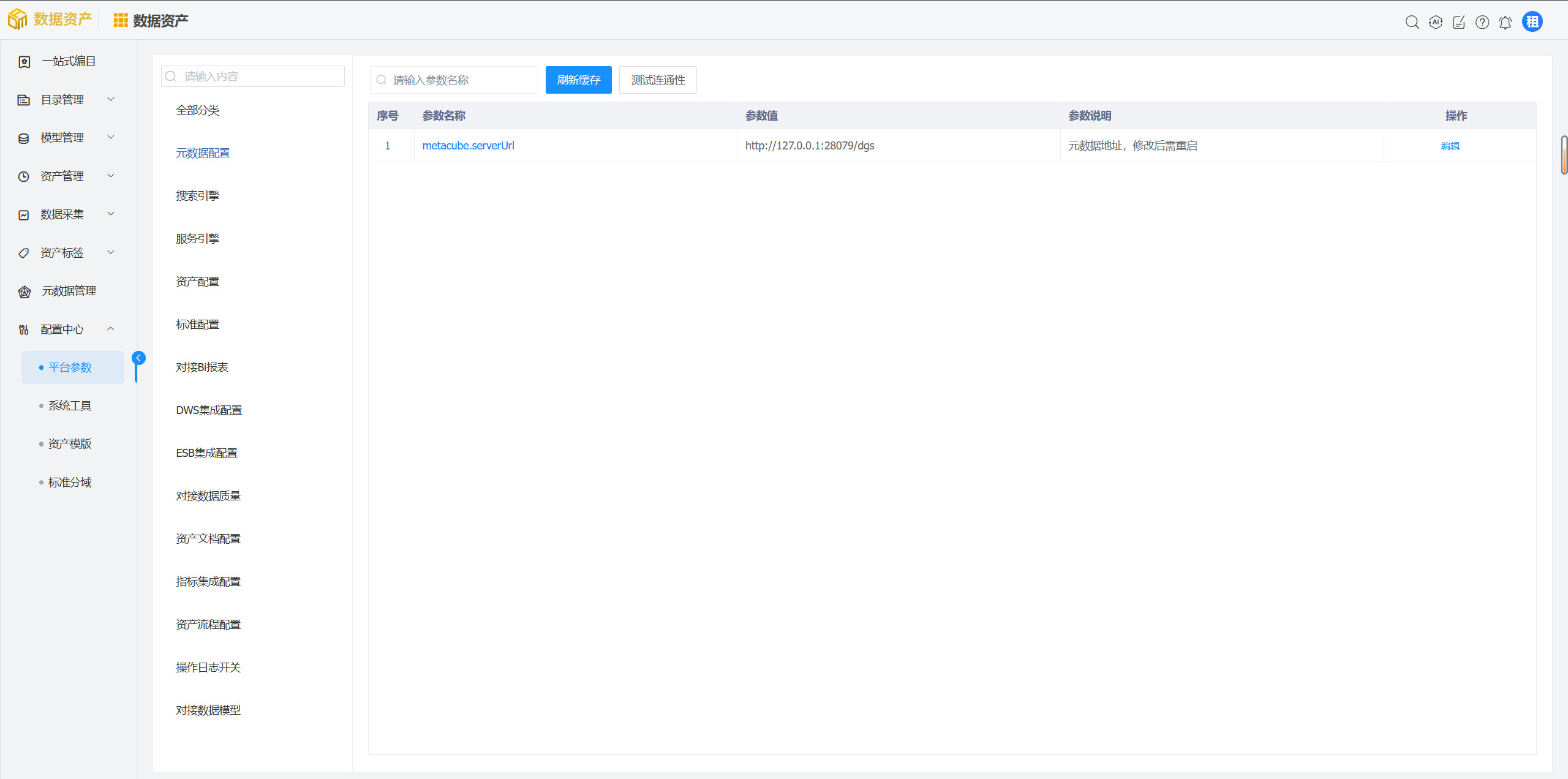

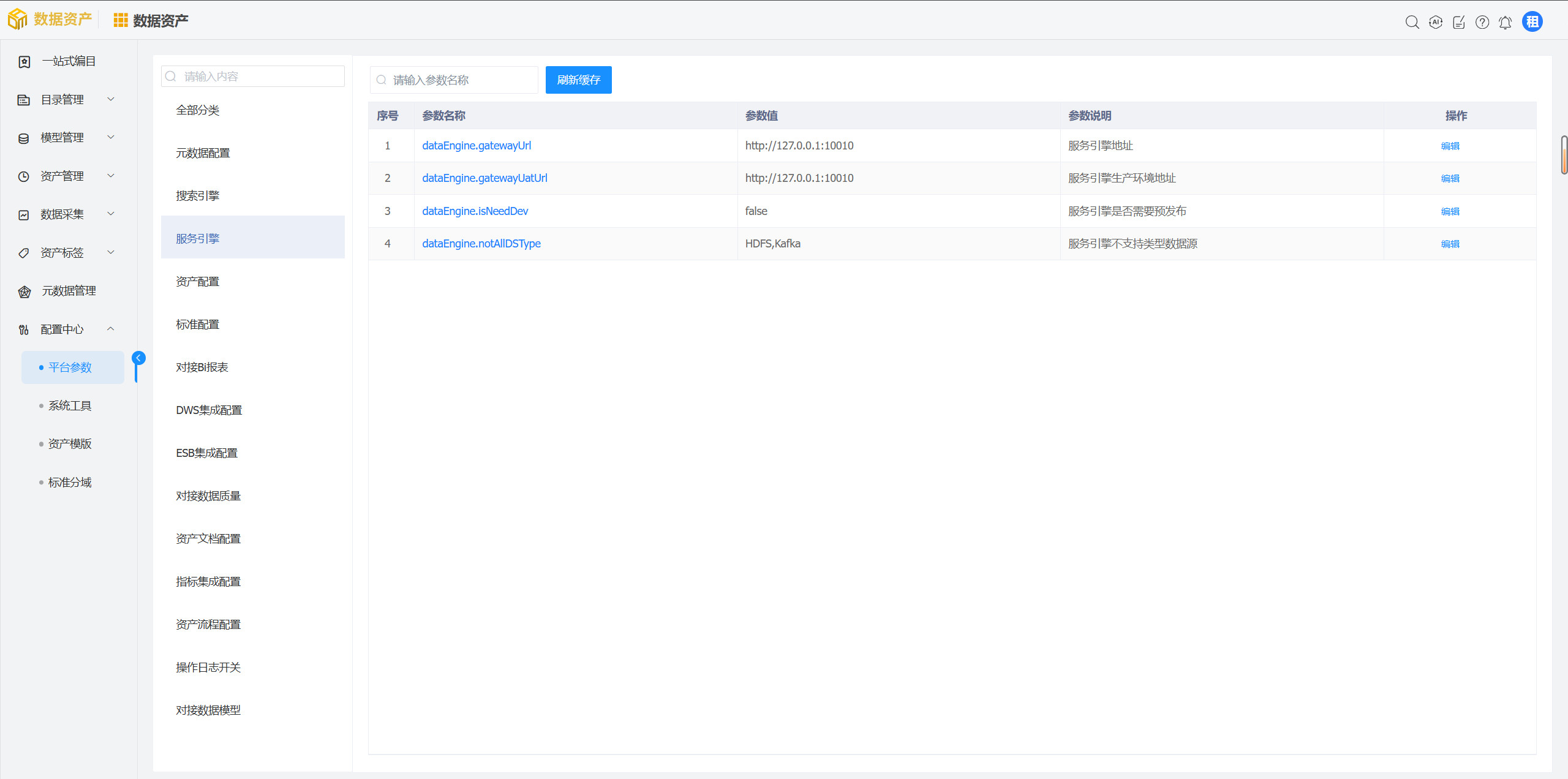

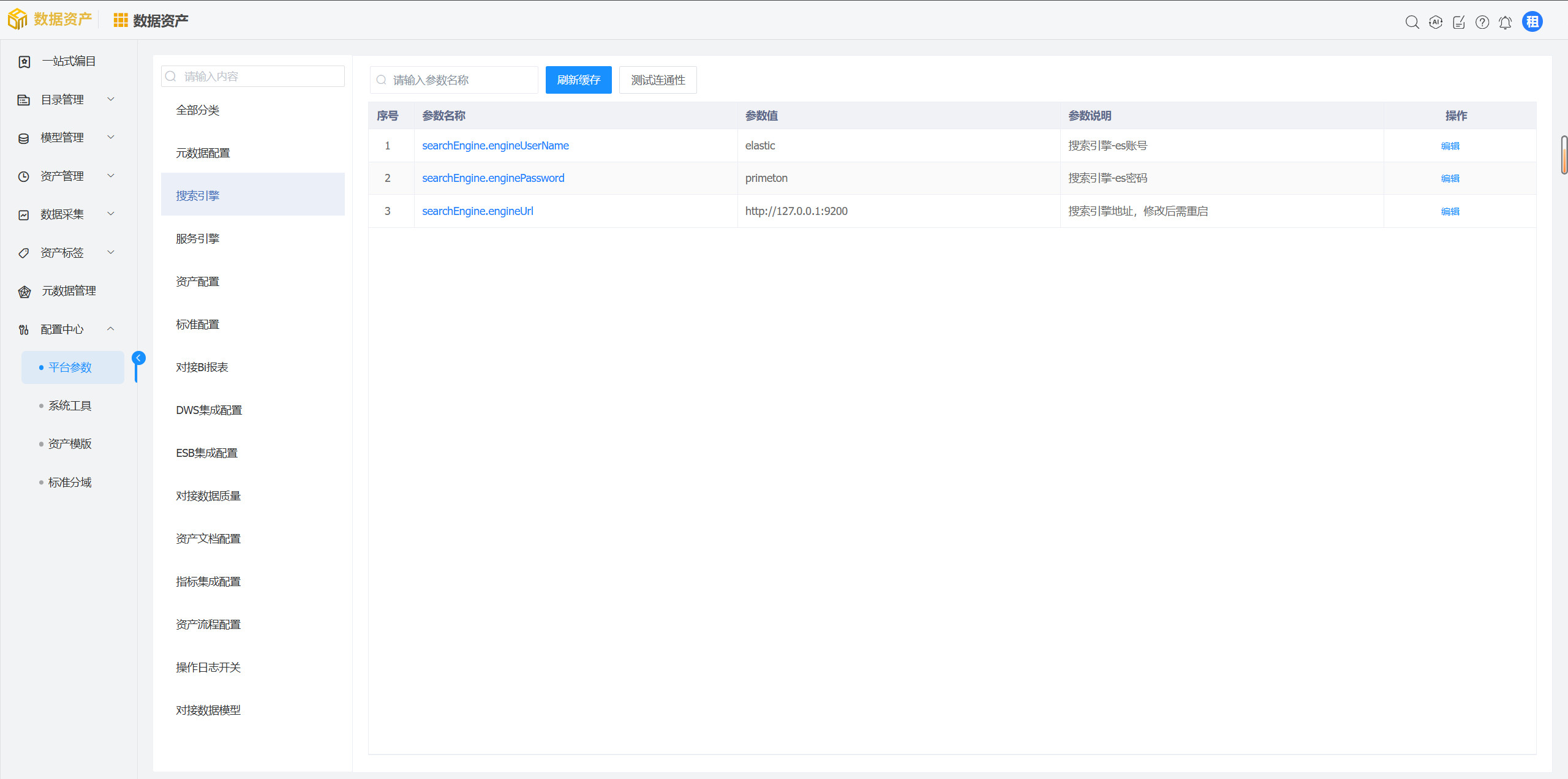

第一次登录系统后需要修改部分平台参数,【技术门户】-【配置中心】-【平台参数配置】其中必须初始化的配置参数包括元数据配置、服务引擎、搜索引擎。修改配置后需要重新启动DAMP后端应用。

PS:也可以直接在数据库中修改,平台配置表:comp_system_config。

修改完成后建议重启DAMP。

# 1.元数据配置

元数据集成相关配置

修改元数据地址。

关键参数说明:

metacube.serverUrl : 元数据dgs后端服务地址。地址需要是真实ip地址,不能配置成127.0.0.1。

# 2.服务引擎配置

服务引擎对应端口,此处配置的地址需要是真实ip地址,不能配置成127.0.0.1。

关键参数说明:

dataEngine.gatewayUrl : 服务引擎生产环境地址,主要作用于页面服务地址显示。

dataEngine.gatewayUatUrl :服务引擎测试环境地址,主要应用服务现在测试时调用服务时使用。

dataEngine.isNeedDev: 服务引擎默认不需要预发布,如果需要预发布动作修改为 true

# 3.修改搜索引擎配置

默认使用elasticsearch作为搜索引擎,用户需要按照安装的es服务地址配置。

关键参数说明:

searchEngine.engineUrl : es的http服务地址,支持https。

searchEngine.engineUserName :es认证账号,如果es开启了xpack账号密码认证,则需要填写。

searchEngine.enginePassword :es认证密码,如果es开启了xpack账号密码认证,则需要填写。

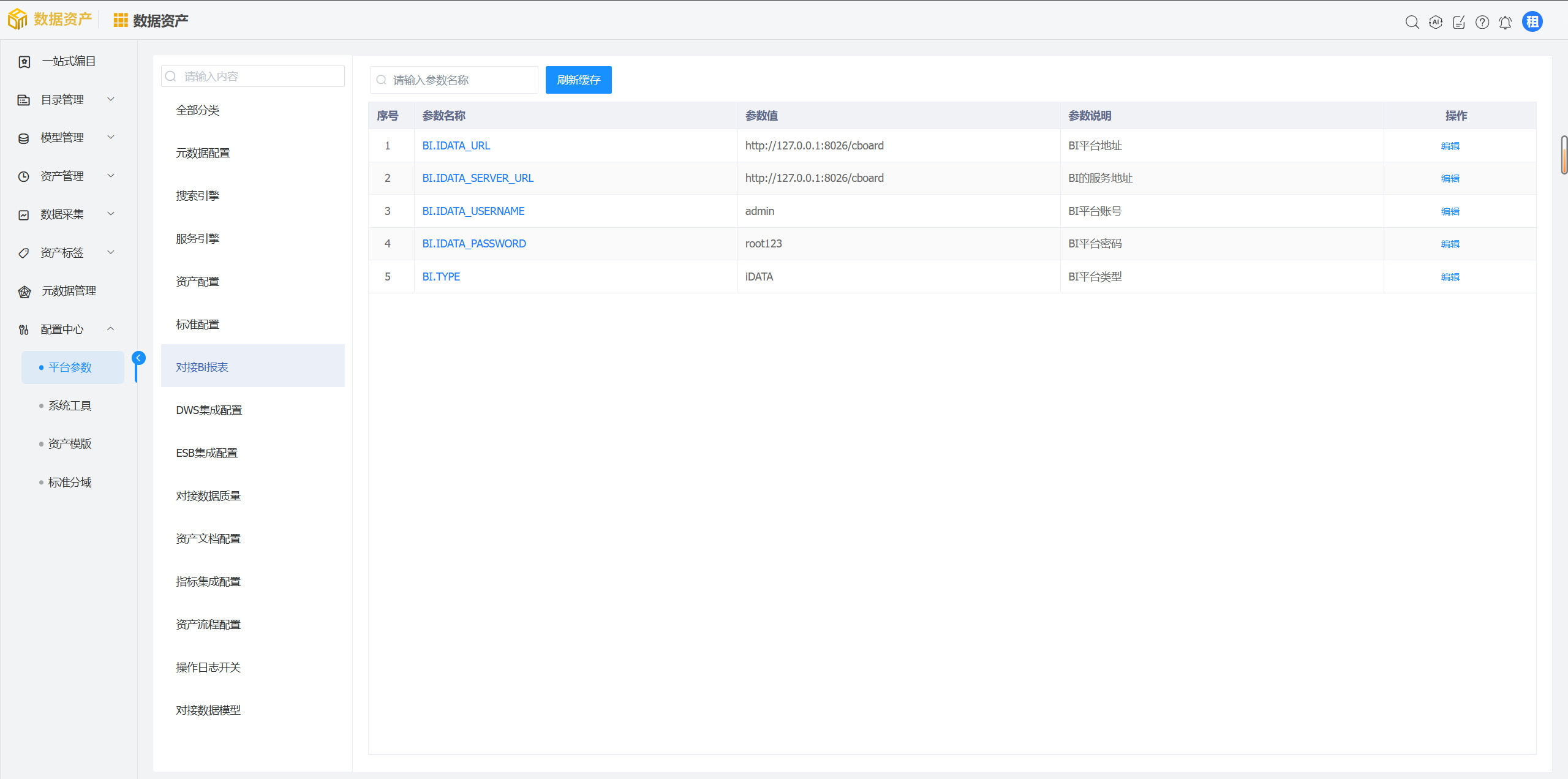

# 4.修改IDATA报表集成配置

7.5.1版本中集成了Idata组件,因此默认配置会开启。

数据指标使用的内置BI为 IDATA,如果使用数据指标需修改IDATA正确地址

关键参数说明:

BI.IDATA_URL : ###idata平台访问地址,可根据真实情况修改。

BI.IDATA_SERVER_URL : ###idata平台接口地址,可根据真实情况修改。。

BI.IDATA_USERNAME : ###idata访问账户名,可根据真实情况修改。。

BI.IDATA_PASSWORD : ###idata访问账户密码,可根据真实情况修改。。

# 第十步、数据资产Logo替换

1.进入/Primeton_DAMP_7.5.0_MicroApp/Primeton_DAMP_7.5.0_Server/damp/damp目录,将logo文件进行替换:

mv -f DAMP_logo_deep_big.svg /opt/primeton/web/afcenter/static/images/AFC_logo.svg

mv -f logo-afc.svg /opt/primeton/web/afcenter/static/images/home/logo-afc.svg

mv -f favicon.ico /opt/primeton/web/afcenter/static/favicon.ico

2.前端刷新缓存即可;

# 第十一步、上传素材库

找到素材库,在AFCENTER 上传 /Primeton_DAMP_7.5.0_Server/material/deploy/DAMP_assetlib.zip

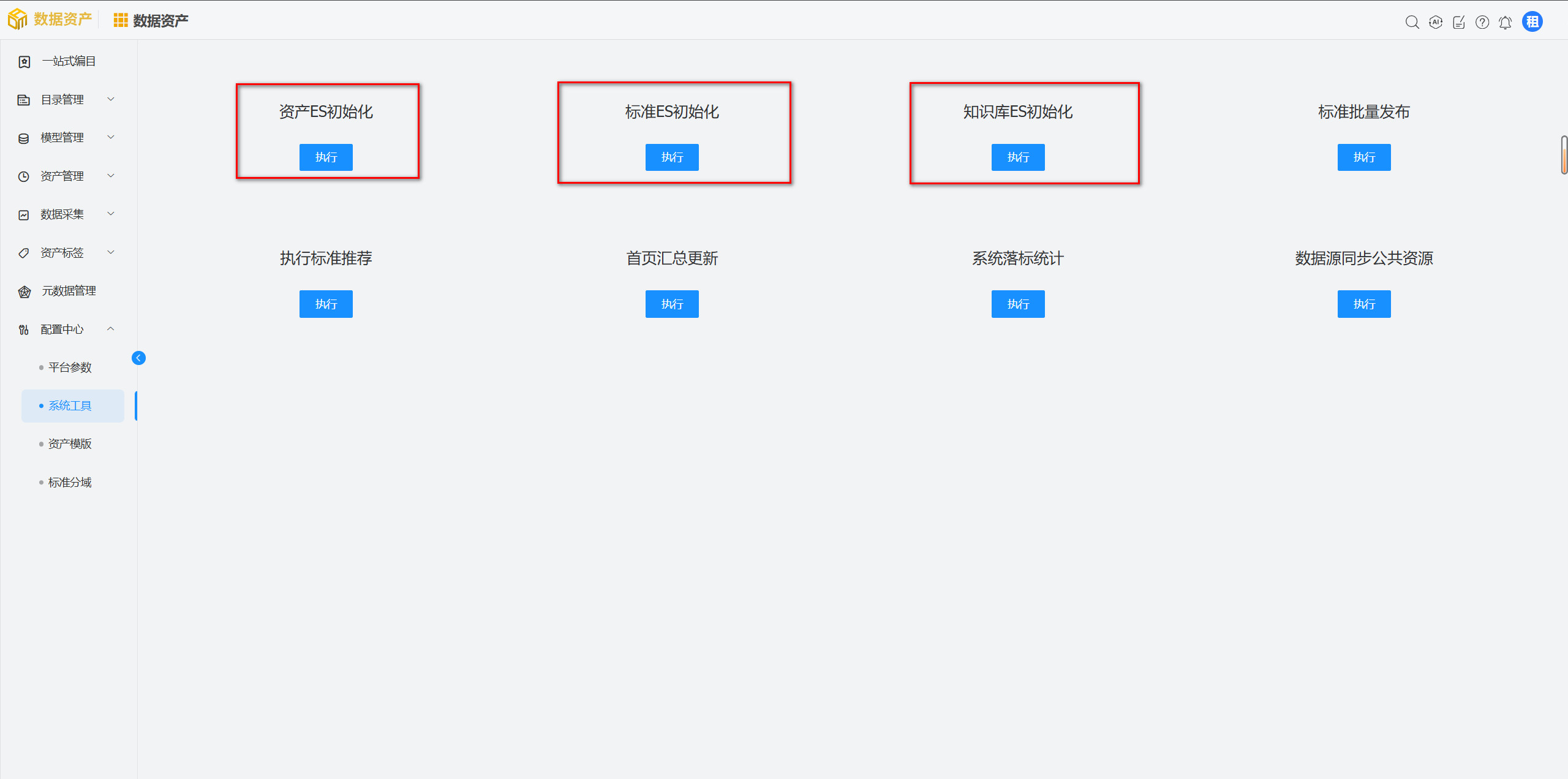

# 第十二步、初始化Elasticsearch索引

在【技术门户】-【配置中心】-【系统工具】中,点击“资产ES初始化”,“标准ES初始化”,“知识库ES初始化”按钮即可。