# 产品安装指南

# 安装准备

# 机器资源

所有环境需要安装 CentOS Linux release 7.4/windows10 操作系统。(请使用最小安装方式安装,避免存在已有安装包与平台安装包冲突的情况)

安装建议机器配置

| 机器 | 最低配置 | 建议配置 | 安装软件 |

|---|---|---|---|

| 机器 1 | 4c16g200g | 8c16g200g | 数据资产整套环境 |

| 机器 2 | 4c16g200g | 8c16g400g | MySQL 5.7 |

# 介质清单

普元数据资产管理平台提供两个版本的介质,分别是微应用版和独立版。其中微应用版需要结合 EOS8.2.2 微服务平台使用,而独立版本可直接安装运行。

微应用版:Primeton_DAMP_7.2_GA_MicroApp.tar.gz(包含三个压缩介质)

├── Primeton_DAMP_7.2_GA_DataEngine.tar.gz

│ ├── README.md

│ ├── bin

│ ├── config

│ ├── data-service-engine-7.2.0-exec.jar

│ ├── lib

│ └── version.properties

├── Primeton_DAMP_7.2_GA_Server.tar.gz

│ ├── bin

│ ├── com.primeton.data.dam.portal.boot-7.2.jar

│ ├── config

│ ├── damp

│ ├── db-scripts

│ ├── lib

│ ├── template-file

│ └── version.properties

└── Primeton_DAMP_7.2_GA_UI.tar.gz

└── web

├── dam

├── dam_portal

├── dataService

└── dm #本次新增的数据建模组件集成

独立版:Primeton_DAMP_7.2_GA_Standalone.tar.gz

├── clearLog.cmd

├── clearLog.sh

├── server

│ ├── damp

│ │ ├── bin

│ │ ├── com.primeton.data.dam.standalone.boot-7.2.jar

│ │ ├── config

│ │ ├── damp

│ │ ├── db-scripts

│ │ ├── lib

│ │ ├── template-file

│ │ └── version.properties

│ ├── dataenginedev

│ │ ├── README.md

│ │ ├── bin

│ │ ├── config

│ │ ├── data-service-engine-7.2.0-exec.jar

│ │ ├── lib

│ │ └── version.properties

│ └── dataengineprod

│ ├── README.md

│ ├── bin

│ ├── config

│ ├── data-service-engine-7.2.0-exec.jar

│ ├── lib

│ └── version.properties

├── shutdown.cmd

├── shutdown.sh

├── startup.cmd

├── startup.sh

└── web

├── afcenter

│ ├── assets

│ ├── bfp

│ ├── components

│ ├── components-ext

│ ├── config

│ ├── dam

│ ├── dam_portal

│ ├── dataService

│ ├── dm

│ ├── formDesigner

│ ├── ide

│ ├── index.html

│ ├── portal

│ ├── remoteEntry.js

│ ├── remoteEntry.js.gz

│ ├── static

│ ├── version.properties

│ └── widget

└── conf

├── damp.conf

└── metacube.conf

# JDK 环境准备

普元数据资产管理平台支持的 JDK 为 OracleJDK 1.8、OpenJDK 1.8,部署之前需要预先安装 JDK 并配置环境变量。

# 数据库环境准备

普元数据资产管理平台支持的数据库厂商有:MySQL 5.7,部署之前需要将对应的数据库环境安装完成。

# Nginx 环境准备

普元数据资产管理平台使用的 Nginx 版本为 1.20.1,需要预先安装 Nginx 环境。

# Redis 环境准备

普元数据资产管理平台使用的 Redis 版本为 6.2.6,需要在部署前安装完成。

# ElasticSearch 环境准备

普元数据资产管理平台使用的 ElasticSearch 版本为 6.4.3,需要在部署前安装完成。

# filebeat 环境准备

普元数据资产管理平台使用的 filebeat 版本为 6.4.3,需要用户自行准备安装。filebeat 需要和 dataengine 安装在同一台服务器上。

#启动filebeat

[root@autotest-01 filebeat-7.0.0-linux-x86_64]# ./filebeat -c data-engine-filebeat.yml &

- filebeat:data-engine-filebeat.yml

filebeat.inputs:

- type: log

paths: ["/opt/dataEngine/logs/api.log*"]

encoding: UTF-8

fields:

log-type: api-log

tags: ["api-log"]

exclude_files: [".gz$"]

json.keys_under_root: true

json.add_error_key: true

json.overwrite_keys: true

output:

logstash:

hosts: ["127.0.0.1:5044"]

# logstash 环境准备

普元数据资产管理平台使用的 logstash 版本为 6.4.3,需要在部署前安装完成。

#启动logstash

[root@autotest-01 logstash-6.4.3]# ./bin/logstash -f config/data-engine.conf 2>&1 &

- logstash:data-engine.conf

input {

beats {

port => 5044

}

}

filter {

date {

match => [ "time", "UNIX_MS" ]

locale => "cn"

timezone => "Asia/Shanghai"

target => "covert-time"

}

# calculate time UTC + 8h -> Asia/Shanghai

ruby {

code => "event.set('covert-time', event.get('covert-time').time.localtime + 8*60*60)"

}

mutate {

convert => ["covert-time", "string"]

}

# -----

# replace logstash @timestamp with log timestamp, and output.elasticsearch create index use this time

# -----

date {

match => [ "covert-time", "YYYY-MM-dd'T'HH:mm:ss.SSSZ", "ISO8601" ]

locale => "cn"

timezone => "Asia/Shanghai"

}

}

output {

elasticsearch {

hosts => ["127.0.0.1:9200"]

index => "%{[fields][log-type]}-%{+YYYY.MM.dd}"

document_type => "log"

}

}

# 元数据环境准备

普元数据资产管理平台依赖普元元数据(7.5GA)平台,需要在部署前安装完成。

# 微应用版本安装

文档中以 MySQL 数据安装为示例进行安装。

# 第一步:安装介质准备

1.数据资产微服务版:Primeton_DAMP_7.2_GA_MicroApp.tar.gz(包含DAMP前后端和服务引擎)

2.EOS8.2SP1基础环境:

EOS_Platform_8.2.6_Private_Medium_Application.tar.gz(基础运行环境,必须)

EOS_Platform_8.2.6_Private_Medium_Service.tar.gz(可选,主要涉及到日志采集和监控模块)

5.Nginx:推荐使用1.20.1版本。(必须)

6.Redis:推荐使用6.2.6版本。(必须)

7.ElasticSearch:推荐使用6.4.3版本,如果已经安装了EOS_Platform_8.2LA3_Private_Medium_Service.tar.gz,则不需要再单独安装。(必须)

8.JDK:推荐使用Oracle JDK1.8.0_162。(必须)

9.filebeat:使用ElasticSearch配套的6.4.3版本。(服务日志采集组件,可选)

10.logstash:使用ElasticSearch配套的6.4.3版本。(服务日志采集组件,可选)

11.MetaCube:元数据7.5GA版本(必须)

Primeton_MetaCube_7.5GA_Extractor.tar

Primeton_MetaCube_7.5GA_Server.tar

Primeton_MetaCube_7.5GA_UI.tar

# 第二步:安装EOS_Platform_8.2 SP1(8.2.6)基础环境

安装步骤详见EOS环境搭建。

PS:文档默认安装目录是/opt/primeton,该路径可以自行修改,注意修改后下述文件路径自行调整。

# 第三步:数据库初始化

# 创建数据库用户/Schema

创建 damp 数据库。以Mysql为例,执行如下脚本:

CREATE DATABASE `damp` DEFAULT CHARACTER SET utf8mb4;

# 执行初始化脚本

微应用安介质安装时需要按顺序执行对应数据库的数据库初始化脚本。初始化脚本路径为 Primeton_DAMP_7.2_GA_Server/db-scripts/,根据不同数据库类型做了不同的目录。目前已经适配的数据库包括Mysql5.7、Postgresql12、达梦V8、人大金仓V8R6、高斯openGuass 5.0.0。

目前数据库脚本一共分成了4部分,分别是bfp、eos、lowcode和damp。 其中bfp、eos、lowcode作为基础组建依赖,都需要在dam库中做初始化,默认执行all.sql即可。 damp中包含了afcenter和bps的数据初始化内容,需要分别在dam、afcenter、bps三个库中执行对应脚本。

以Mysql为例,按顺序执行如下脚本:

1)在damp数据库下执行:

1.bfp

db-scripts/bfp/Mysql/all.sql

2.eos

db-scripts/eos/Mysql/all.sql

3.lowcode

db-scripts/lowcode/Mysql/all.sql

4.damp

db-scripts/damp/Mysql/dam-all.sql

2)在afcenter数据库下执行:

1.db-scripts/damp/dam-afc-all.sql #需要先完成afcenter基础环境数据库的初始化

3)在bps数据库下执行:

1.db-scripts/damp/dam-bps-all.sql #需要先完成bps基础环境数据库的初始化

# 第四步:DAMP 后端部署

# 1.解压介质

在/opt/primeton/server目录下创建 damp 文件夹,将 Primeton_DAMP_7.2_GA_Server 复制到 damp 目录下并解压。

# 2.配置文件修改

微应用安介质安装时的配置文件,有需要修改的地方会在后面用“###”提示说明。

1.damp/config/application.properties #公共配置

2.damp/config/application-afc.properties #afcenter集成配置

3.damp/config/application-damp.properties #damp自身配置

4.damp/config/application-nacos.properties #nacos注册中心配置

5.damp/config/bootstrap.properties #nacos配置中心配置

6.damp/config/DAMP/config/user-config.xml #damp数据源配置

7.damp/config/application-dm.properties #7.2版本新增,用于建模模块配置

1)公共配置:damp/config/application.properties

server.port=28078 ###可根据实际情况修改,注意端口冲突

spring.application.name=DAMP ###原则上不允许修改

server.servlet.session.timeout=PT120M

server.app-server.accept-count=1000

server.app-server.max-connections=10000

server.app-server.max-threads=500

server.app-server.min-space-threads=50

#file upload

spring.servlet.multipart.max-file-size=100MB ###文件上传大小限制,与nginx配套修改

spring.servlet.multipart.max-request-size=100MB ###同上

#spring.profiles.active=eureka

spring.profiles.active=nacos,afc,damp,dm

spring.autoconfigure.exclude=org.springframework.boot.autoconfigure.mongo.MongoAutoConfiguration

management.endpoints.web.exposure.include=hystrix.stream,health,info,loggers,eos,mappings

out.config.folder=config

eos.application.sys-code=EOS-DEMO-SYS ###EOS默认配置,可以不修改。如果在Governor中配置需要根据配置情况修改

eos.application.sys-key=dc6baaed30e541d78bb91274803d9432 ###同上

# eos environment: dev prod test

eos.profiles.active=dev

# eos-cache

eos.cache.mode=redis

spring.redis.host=127.0.0.1 ###修改redis对应ip,本机则不需要修改

spring.redis.port=6379 ###修改redis对应端口,默认端口不需要修改

spring.redis.password= ###如果redis开启认证则需要配置密码

spring.redis.lettuce.pool.max-active=100

spring.redis.lettuce.pool.max-idle=100

spring.redis.lettuce.pool.max-wait=5000

2)afcenter组件配置:damp/config/application-afc.properties

afc.application.name=AFCENTER ###根据实际情况修改

afc.application.tenant=sys_tenant

bps.application.name=BPS-SERVER ###根据实际情况修改

bps.tenant.id=

# attachment

# mode: local,db,nexus,aliyun-oss

afc.attachments.persistence-mode=local ###根据实际情况修改

afc.attachments.local.dir=

afc.attachments.nexus.repository-url=

afc.attachments.nexus.username=

afc.attachments.nexus.password=

afc.attachments.aliyun-oss.endpoint=

afc.attachments.aliyun-oss.access-key-id=

afc.attachments.aliyun-oss.access-key-secret=

afc.attachments.aliyun-oss.bucket-name=

afc.attachments.libre-office.host=

afc.attachments.libre-office.port=

3)damp组件配置:damp/config/application-damp.properties

eos.export.depend-api-contributions=com.primeton.data.dam.api

# dm

dm.application.name=127.0.0.1:28078 ###7.2版本引入了建模模块,因此改成本地接口调用,后续版本会替换成sdk

# quality

quality.application.name=QUALITY ###数据质量应用名,用于接口调用访问,可以配置成ip+端口,也可以配置成应用名

4)注册中心配置:damp/config/application-nacos.properties

spring.cloud.nacos.discovery.enabled=true

spring.cloud.nacos.discovery.server-addr=127.0.0.1:8848 ###根据实际情况修改

#spring.cloud.nacos.discovery.username=nacos

#spring.cloud.nacos.discovery.password=nacos

eureka.client.enabled=false

5)配置中心配置:damp/config/bootstrap.properties

spring.cloud.nacos.config.enabled=true

spring.cloud.nacos.config.server-addr=127.0.0.1:8848 ###根据实际情况修改

#spring.cloud.nacos.config.username=nacos

#spring.cloud.nacos.config.password=nacos

6)数据源配置:damp/config/DAMP/config/user-config.xml

...

<group name="default"> ### 根据实际情况修改

<configValue key="Database-Type">MySql</configValue>

<configValue key="Jdbc-Type"/>

<configValue key="C3p0-DriverClass">com.mysql.jdbc.Driver</configValue>

<configValue key="C3p0-Url">jdbc:mysql://127.0.0.1:3306/damp?useUnicode=true&characterEncoding=UTF-8&serverTimezone=GMT%2B8&useSSL=false</configValue>

<configValue key="C3p0-UserName">username</configValue>

<configValue key="C3p0-Password">password</configValue>### 明文密码,启动后会自动加密

<configValue key="C3p0-PoolSize">10</configValue>

<configValue key="C3p0-MaxPoolSize">50</configValue>

<configValue key="C3p0-MinPoolSize">10</configValue>

<configValue key="C3p0-MaxIdleTime">600</configValue>

<configValue key="C3p0-IdleConnectionTestPeriod">900</configValue>

<configValue key="C3p0-MaxStatements">0</configValue>

<configValue key="C3p0-NumHelperThreads">1</configValue>

<configValue key="Transaction-Isolation">ISOLATION_DEFAULT</configValue>

<configValue key="Test-Connect-Sql">SELECT count(*) from EOS_UNIQUE_TABLE</configValue>

<configValue key="Retry-Connect-Count">1</configValue>

</group>

...

7)建模配置:damp/config/application-dm.properties

#jackson

spring.jackson.date-format=yyyy-MM-dd HH:mm:ss

spring.jackson.time-zone=GMT+8

spring.jackson.default-property-inclusion=non-null

spring.jackson.deserialization.fail-on-unknown-properties=false

#jpa

spring.jpa.open-in-view=false

spring.jpa.properties.javax.persistence.validation.mode=none

spring.jpa.hibernate.ddl-auto=none

spring.jpa.properties.hibernate.show_sql=true

spring.jpa.properties.hibernate.format_sql=true

spring.jpa.show-sql=false

## Database Dialect

## MySQL

spring.jpa.properties.hibernate.dialect=org.hibernate.dialect.MySQL5Dialect

## Oracle

# spring.jpa.properties.hibernate.dialect=org.hibernate.dialect.Oracle10gDialect

## SQLServer

# spring.jpa.properties.hibernate.dialect=org.hibernate.dialect.SQLServer2012Dialect

## Dameng

#spring.jpa.properties.hibernate.dialect=org.hibernate.dialect.DmDialect

### GaussDB

#spring.jpa.database=postgresql

#spring.jpa.properties.hibernate.dialect=org.hibernate.dialect.PostgreSQL9Dialect

#spring.jpa.properties.hibernate.temp.use_jdbc_metadata_defaults = false

#task

spring.task.scheduling.pool.size=5

spring.task.execution.pool.core-size=50

spring.task.execution.pool.max-size=100

spring.task.execution.pool.queue-capacity=100000

#file upload

spring.servlet.multipart.max-file-size=100MB

spring.servlet.multipart.max-request-size=100MB

spring.servlet.multipart.enabled=true

spring.servlet.multipart.location=${user.dir}/data/upload-tmp

spring.servlet.multipart.file-size-threshold=100KB

management.endpoints.web.exposure.include=*

management.health.redis.enable=false

# damp

damp.application.name=127.0.0.1:28078 ###damp默认端口,根据实际情况修改

# 第五步.dataEngine 后端部署

# 1.解压介质

1. 在/opt/primeton/server下创建 dataengineprod、dataenginedev 目录。其中 dataengineprod 是生产环境引擎,dataenginedev 是测试环境引擎。

2. 将 Primeton_DAMP_7.2_GA_DataEngine.tar.gz 复制到 dataengineprod、dataenginedev 目录下,解压后将数据库驱动放到 lib 目录下。

# 2.配置文件修改

数据资产后端配置文件如下:

server/dataengineprod/config/application.properties

server/dataenginedev/config/application.properties

生产环境配置:dataengineprod/config/application.properties

#-根据实际情况修改 PROD/DEV

spring.application.name=DataEnginePROD

server.port=10010

server.tomcat.max-connections=10000

server.tomcat.max-threads=1000

server.tomcat.min-spare-threads=100

# alibaba nacos

spring.cloud.nacos.discovery.enabled=true

spring.cloud.nacos.discovery.server-addr=127.0.0.1:8848 ###nacos注册中心配置,根据实际情况修改

spring.cloud.nacos.discovery.username=nacos ###nacos注册中心配置,根据实际情况修改

spring.cloud.nacos.discovery.password=nacos ###nacos注册中心配置,根据实际情况修改

spring.servlet.multipart.enabled=true

spring.servlet.multipart.max-request-size=100MB

spring.servlet.multipart.max-file-size=20MB

spring.servlet.multipart.location=${user.dir}/data/upload-tmp

spring.servlet.multipart.file-size-threshold=100KB

spring.jackson.date-format=yyyy-MM-dd HH:mm:ss

spring.jackson.time-zone=GMT+8

spring.jackson.default-property-inclusion=ALWAYS

spring.jackson.deserialization.fail-on-unknown-properties=false

spring.task.scheduling.pool.size=5

spring.task.execution.pool.core-size=50

spring.task.execution.pool.max-size=100

spring.task.execution.pool.queue-capacity=100000

management.endpoints.web.exposure.include=*

#-根据实际情况修改数据库配置

spring.datasource.driver-class-name=com.mysql.cj.jdbc.Driver

spring.datasource.url=jdbc:mysql://172.50.1.12:3306/ems4catalog?useUnicode=true&characterEncoding=UTF-8&useSSL=false&serverTimezone=GMT%2b8

spring.datasource.username=root

spring.datasource.password=primeton123456

spring.datasource.pool-name=default

spring.datasource.minimum-idle=1

spring.datasource.maximum-pool-size=5

#-根据实际情况修改Redis配置

spring.redis.host=127.0.0.1 ###redis配置,根据实际情况修改

#spring.redis.port=6379 ###redis配置,根据实际情况修改

engine.runtime.group=DEFAULT

#-根据实际情况修改 PROD/DEV

engine.runtime.env=PROD

# engine.cache.notify.enabled=false

# none/memory/redis

# engine.security.token-cache.type=redis

# memory/redis

# engine.security.permission-cache.type=redis

# memory/none

# engine.service.spec-cache.type=none

# SQL SERVICE

#service.sql.query.order-column-limits=3

# engine.schedule.spec-cache-cleanup.cron=* 0/10 * * * ?

# Disabled by `-`

engine.schedule.spec-cache-sync.cron=-

# engine.schedule.spec-cache-sync.cron=* 0/10 * * * ?

测试环境配置:server/dataenginedev/config/application.properties

##-引擎环境配置,生产:PROD,测试:DEV

engine.runtime.env=DEV ###环境变量配置

##-根据实际情况修改,生产和测试环境需要所有区分,建议:DataEnginePROD/DataEngineDEV

spring.application.name=DataEngineDEV

server.port=10011

server.tomcat.max-connections=10000

server.tomcat.max-threads=1000

server.tomcat.min-spare-threads=100

# alibaba nacos

spring.cloud.nacos.discovery.enabled=true

spring.cloud.nacos.discovery.server-addr=127.0.0.1:8848

spring.cloud.nacos.discovery.username=nacos

spring.cloud.nacos.discovery.password=nacos

spring.servlet.multipart.enabled=true

spring.servlet.multipart.max-request-size=100MB

spring.servlet.multipart.max-file-size=20MB

spring.servlet.multipart.location=${user.dir}/data/upload-tmp

spring.servlet.multipart.file-size-threshold=100KB

spring.jackson.date-format=yyyy-MM-dd HH:mm:ss

spring.jackson.time-zone=GMT+8

spring.jackson.default-property-inclusion=ALWAYS

spring.jackson.deserialization.fail-on-unknown-properties=false

spring.task.scheduling.pool.size=5

spring.task.execution.pool.core-size=50

spring.task.execution.pool.max-size=100

spring.task.execution.pool.queue-capacity=100000

management.endpoints.web.exposure.include=*

#-根据实际情况修改数据库配置

spring.datasource.driver-class-name=com.mysql.cj.jdbc.Driver

spring.datasource.url=jdbc:mysql://172.50.1.12:3306/ems4catalog?useUnicode=true&characterEncoding=UTF-8&useSSL=false&serverTimezone=GMT%2b8

spring.datasource.username=root

spring.datasource.password=primeton123456

spring.datasource.pool-name=default

spring.datasource.minimum-idle=1

spring.datasource.maximum-pool-size=5

#-根据实际情况修改Redis配置

spring.redis.host=127.0.0.1

#spring.redis.port=6379

engine.runtime.group=DEFAULT

# engine.cache.notify.enabled=false

# none/memory/redis

# engine.security.token-cache.type=redis

# memory/redis

# engine.security.permission-cache.type=redis

# memory/none

# engine.service.spec-cache.type=none

# SQL SERVICE

#service.sql.query.order-column-limits=3

# engine.schedule.spec-cache-cleanup.cron=* 0/10 * * * ?

# Disabled by `-`

engine.schedule.spec-cache-sync.cron=-

# engine.schedule.spec-cache-sync.cron=* 0/10 * * * ?

# 第六步.替换license文件(开发测试环境)

如果是开发测试环境,没有申请临时/正式license时,可以使用damp自带的产品license体验damp功能。

license(源):/opt/primeton/server/damp/config/DAMP/license/primetonlicense.xml

license(目标):/opt/primeton/server/primetonlicense.xml

如果申请license,则注意增加数据资产相关组件 data-asset,data-catalog,data-standard。

# 第七步.前端配置

# 1.解压介质

- 解压 Primeton_DAMP_7.2_GA_UI.tar.gz,在web目录下的 dam 、 dam_portal 、 dataService 、 dm 4个文件夹。

- 将4个文件夹复制到前端afcenter目录下 /opt/primeton/web/afcenter即可。

# 2. 配置文件修改

- 在 nginx 安装目录下的 conf/nginx.conf 配置文件中引入数据资产前端配置。

user root; ##-根据实际用户配置,建议使用root启动

worker_processes 1;

#error_log logs/error.log;

#error_log logs/error.log notice;

#error_log logs/error.log info;

#pid logs/nginx.pid;

events {

worker_connections 1024;

}

http {

include mime.types;

default_type application/octet-stream;

client_max_body_size 100M;

client_body_buffer_size 10M;

fastcgi_intercept_errors on;

#log_format main '$remote_addr - $remote_user [$time_local] "$request" '

# '$status $body_bytes_sent "$http_referer" '

# '"$http_user_agent" "$http_x_forwarded_for"';

#access_log logs/access.log main;

sendfile on;

#tcp_nopush on;

#keepalive_timeout 0;

keepalive_timeout 65;

#gzip on;

include /home/primeton/web/conf/*.conf; ##-根据实际情况修改文件路径

}

- 检查 nginx 配置文件,配置在 /opt/primeton/web/conf/eos8.conf。默认不需要做特殊配置。

upstream eosgateway {

server 127.0.0.1:9090; #gateway默认端口

}

#EOS afcenter by gateway

server {

listen 80;

#client_body_buffer_size 10m; #缓存区大小

client_max_body_size 100m;

#元数据集成配置,如果不做单点登录可以不配。

location /fd_dgs/ {

proxy_pass http://127.0.0.1:83/ ;

}

#元数据集成配置,如果不做单点登录可以不配。

location ^~ /dgs {

charset utf-8;

proxy_pass http://127.0.0.1:28079;

}

location ~ /(.*)/api/ {

proxy_set_header X-EOS-SourceSysKey dc6baaed30e541d78bb91274803d9432;

proxy_pass http://eosgateway;

}

location ~ \.biz\.ext$ {

proxy_set_header X-EOS-SourceSysKey dc6baaed30e541d78bb91274803d9432;

proxy_pass http://eosgateway;

}

location / {

root "/opt/primeton/web/afcenter";

access_log /opt/primeton/web/logs/access.log ;

error_log /opt/primeton/web/logs/error.log warn;

index index.html index.htm;

try_files $uri /index.html;

}

}

#元数据

server {

listen 83;

proxy_buffer_size 128k;

proxy_buffers 32 128k;

proxy_busy_buffers_size 128k;

proxy_set_header Host $host;

proxy_set_header X-Real-IP $remote_addr;

proxy_set_header X-Real-Port $remote_port;

proxy_set_header REMOTE-HOST $remote_addr;

proxy_set_header X-Forwarded-For $proxy_add_x_forwarded_for;

location / {

root /home/primeton/web/meta;

index index.html index.htm;

try_files $uri /index.html;

}

location /dgs {

charset utf-8;

proxy_pass http://127.0.0.1:28079;

}

}

# 第八步.启动服务

# 后端启动

Linux 系统

[root@localhost server]# ./damp/bin/startup.sh

[root@localhost server]# ./dataengineprod/bin/startup.sh

[root@localhost server]# ./dataenginedev/bin/startup.sh

Windows 系统

D:\Desktop\server> ./damp/bin/startup.cmd

D:\Desktop\server> ./dataengineprod/bin/startup.cmd

D:\Desktop\server> ./dataenginedev/bin/startup.cmd

# 前端启动

Linux 系统

[root@localhost nginx]# ./sbin/nginx

Windows 系统

D:\Desktop\server> nginx.exe

# 第九步.环境登录和验证

访问 http://localhost,使用初始用户登录,初始用户名、密码为:dtadmin/000000。

若无法访问,检查是否角色授权!!!

# 第十步.平台配置

第一次登录系统后需要修改部分平台参数,其中必须初始化的配置参数包括元数据配置、服务引擎、搜索引擎。修改配置后需要重新启动DAMP后端应用。

PS:也可以直接在数据库中修改,平台配置表:comp_system_config。

修改完成后建议重启DAMP。

# 1. 元数据配置

元数据集成相关配置,主要是修改元数据地址。如果元数据和DAMP安装在同一台服务器上并且dgs端口未修改,则不需要调整。

关键参数说明:

metacube.serverUrl : 元数据dgs后端服务地址。

# 2. 服务引擎配置

服务引擎对应后端 dataserviceprod 和 dataservicedev 对应端口,此处配置的地址需要是真实ip地址,不能配置成127.0.0.1。此配置修改后不需要重启服务。

关键参数说明:

dataEngine.gatewayUrl : 服务引擎生产环境地址,主要作用于页面服务地址显示。

dataEngine.gatewayUatUrl :服务引擎测试环境地址,主要应用服务现在测试时调用服务时使用。

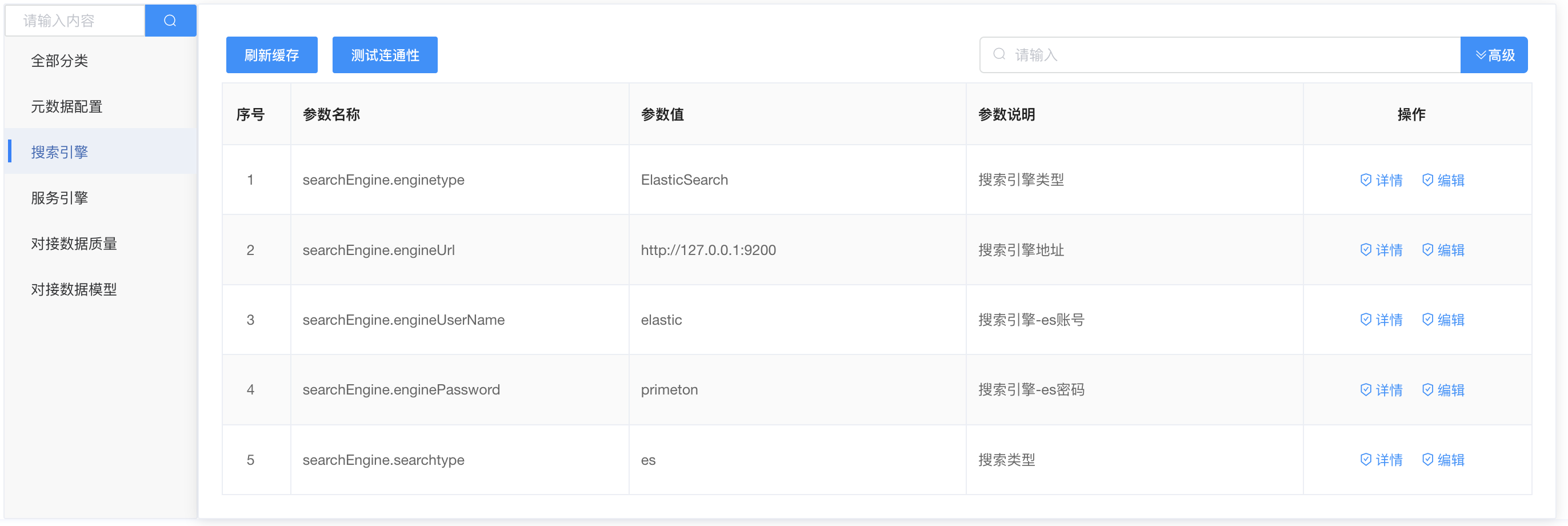

# 3. 修改搜索引擎配置(重启后生效)

默认使用elasticsearch作为搜索引擎,用户需要按照安装的es服务地址配置,修改后需要重启才会生效。

关键参数说明:

searchEngine.engineUrl : es的http服务地址,支持https。

searchEngine.engineUserName :es认证账号,如果es开启了xpack账号密码认证,则需要填写。

searchEngine.enginePassword :es认证密码,如果es开启了xpack账号密码认证,则需要填写。

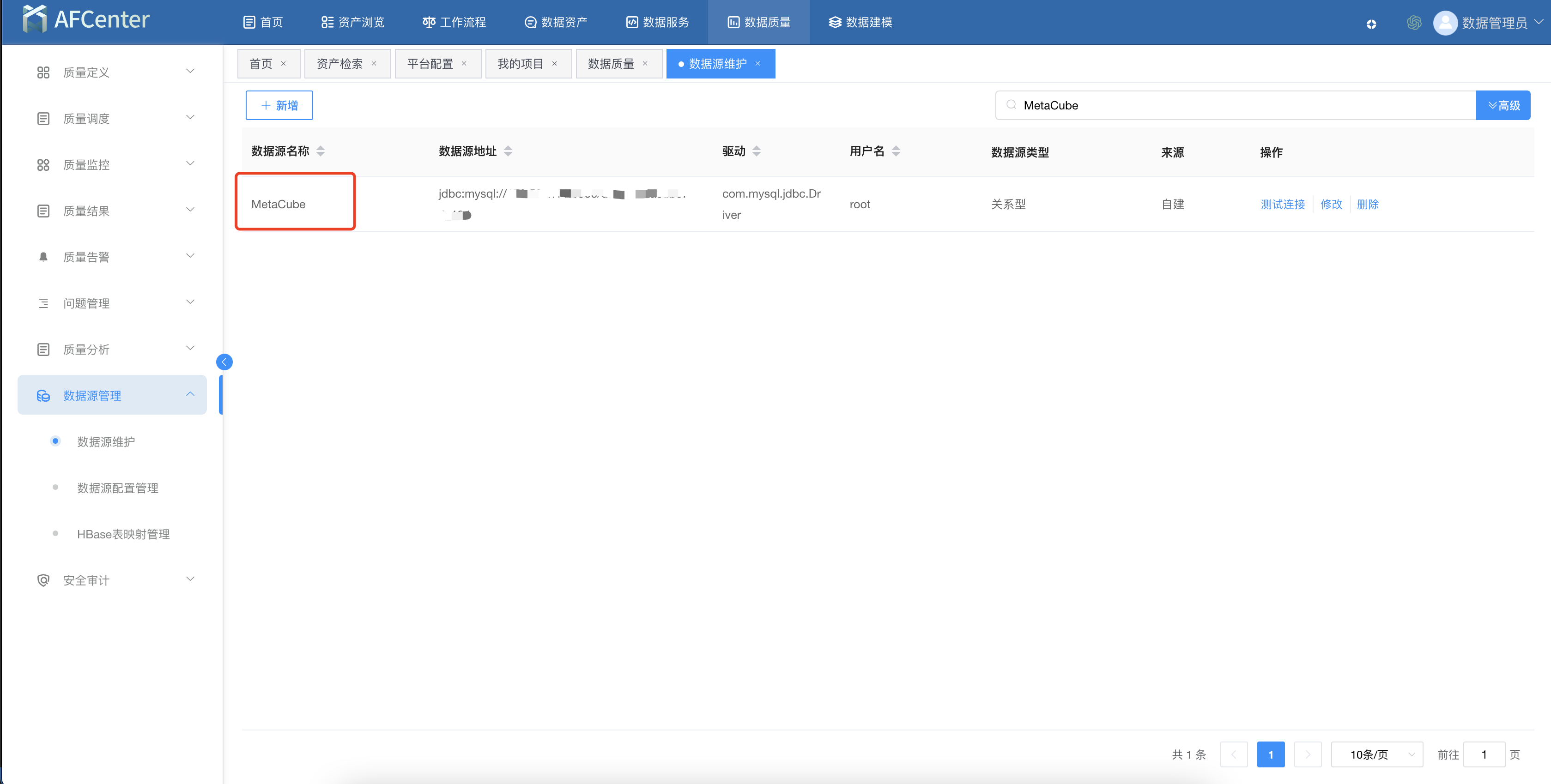

# 4. 修改数据质量集成配置

如果安装了数据质量组件,可以通过修改配置实现集成。配置后可以通过数据元标准维护自动生成数据质量规则,并可以在标准监控中查看规则执行情况。

关键参数说明:

DAM_BUILD_QUALITY.IS_OPEN : 是否启用数据质量集成配置,设置“Y/N”。

DAM_BUILD_QUALITY.dataSourceName :元数据库的数据源名称,此数据源需要在数据质量中预先配置,并保证两边数据源名称一致,默认是“MetaCube”。

# 5. 修改数据建模集成配置

7.2版本中集成了数据建模组件,因此默认配置会开启。此配置默认不需要修改。

关键参数说明:

DAM_BUILD_MODEL.IS_OPEN : 默认打开,如果不需要可以设置成N。

DAM_BUILD_MODEL.MODEL_URL : 数据开发前端跳转地址,默认不需要修改。

# 第十一步.权限配置

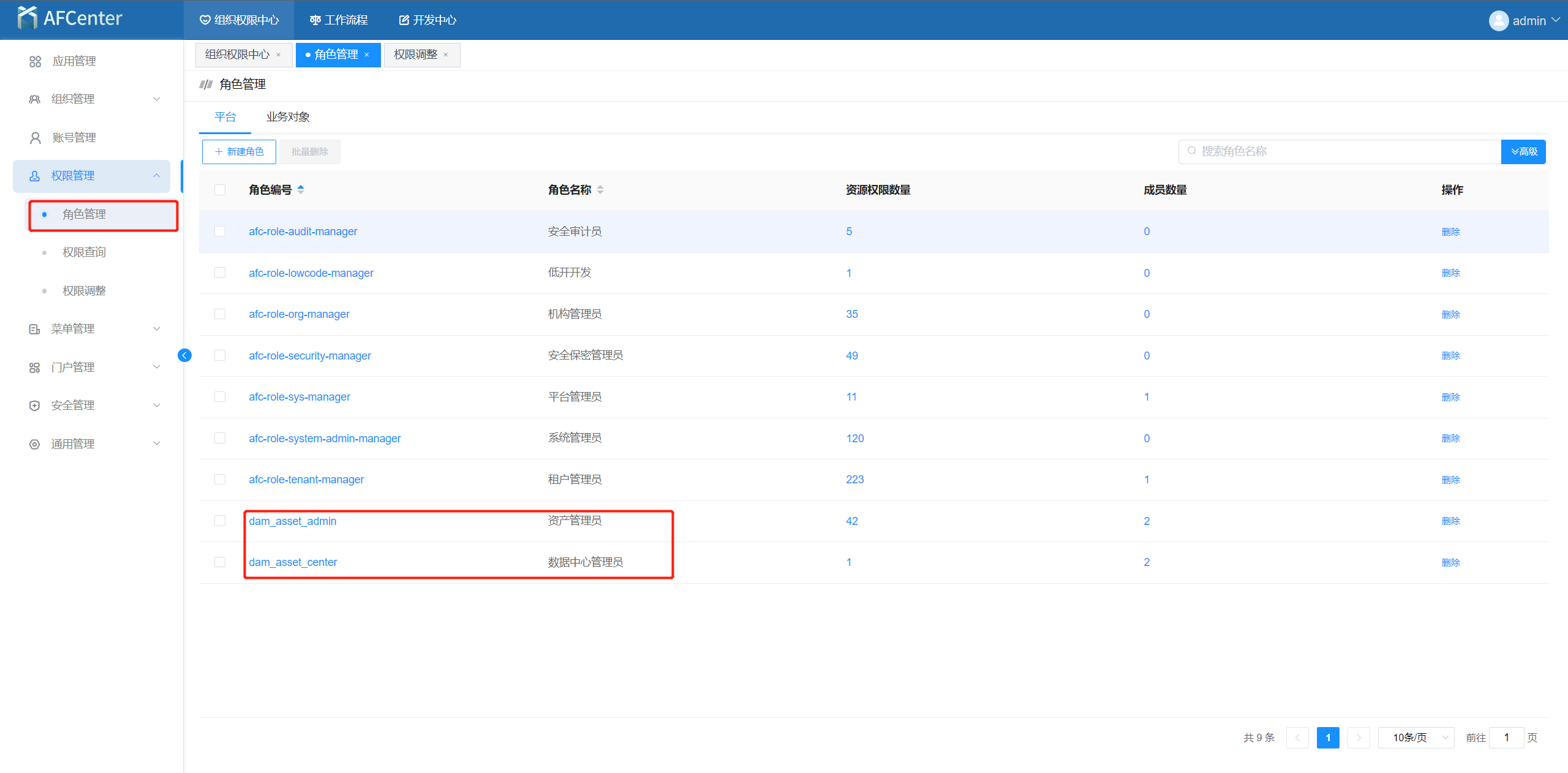

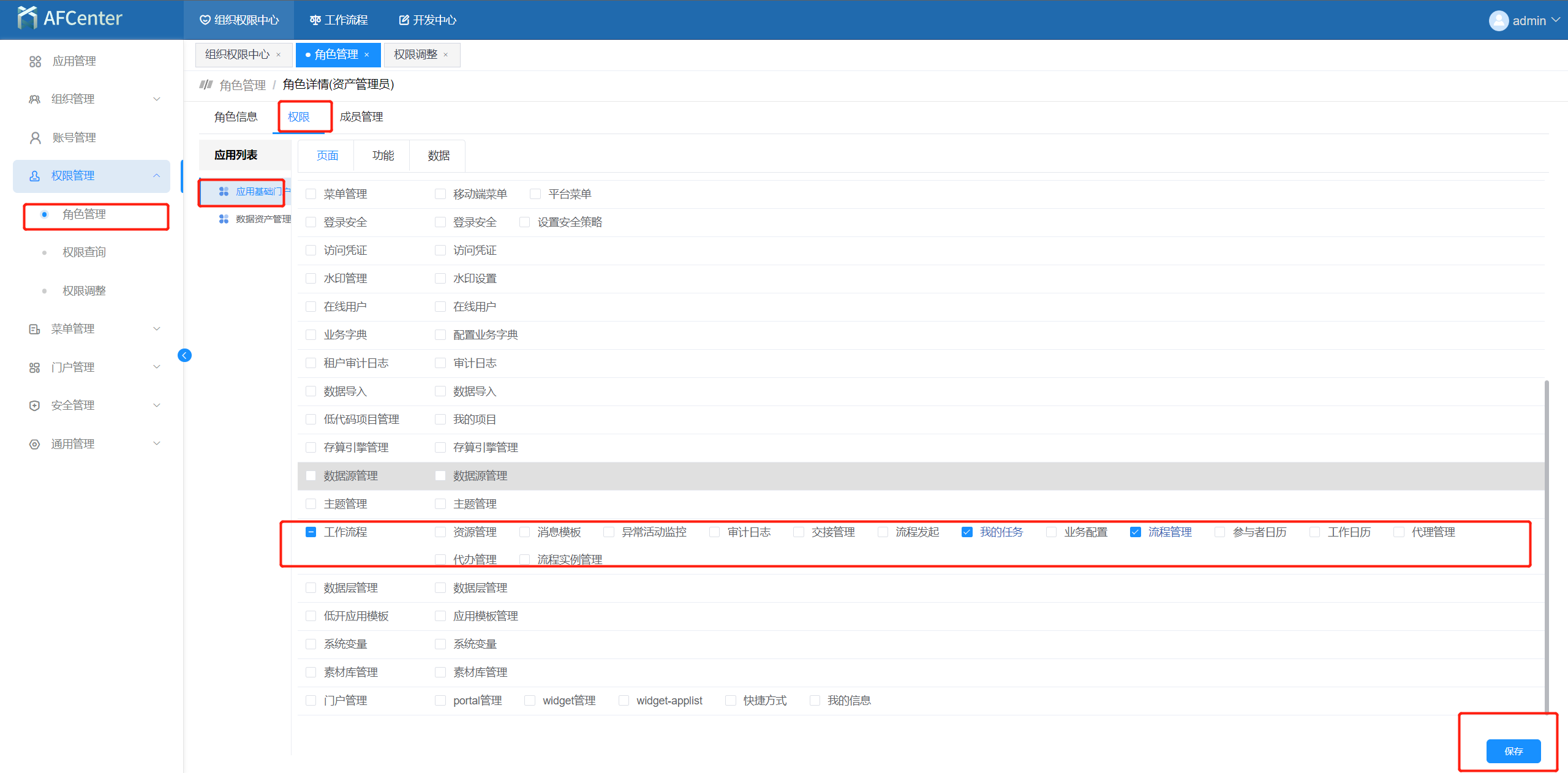

在使用平台前,需要给数据资产管理员和数据中心管理员角色增加部分系统权限。

使用超级管理员 admin 进行角色授权,登录系统后在 组织权限中心->权限管理->角色管理。

找到资产管理员、数据中心管理员两个角色分别找到工作流程,勾选我的任务和流程管理选项并点击保存,完成授权。